IA na rotina do médico: ferramenta de produtividade, não co-autora de diagnóstico

Você tem entre 14 e 25 anos de carreira, consultório consolidado, publicações na sua especialidade, e nas últimas semanas começou a ouvir, com frequência crescente, colegas dizendo que usam ChatGPT no consultório. Algum deles mencionou agente de IA, outro falou em transcrição automática de anamnese, um terceiro disse que prepara material para paciente em segundos.

Você tem duas reações simultâneas. Curiosidade, porque parte do que descrevem de fato libera tempo. E desconforto, porque outra parte da conversa sobre IA na medicina cruza linhas que você não cruzaria. Diagnóstico delegado, autoria clínica sem revisão, publicação automatizada em redes sociais sem checagem técnica.

A sua sensação é correta. Existe um lugar defensável para a IA no consultório, e ele não é o que a maior parte dos cursos vende. E desde fevereiro de 2026, esse lugar tem desenho normativo claro.

resposta direta

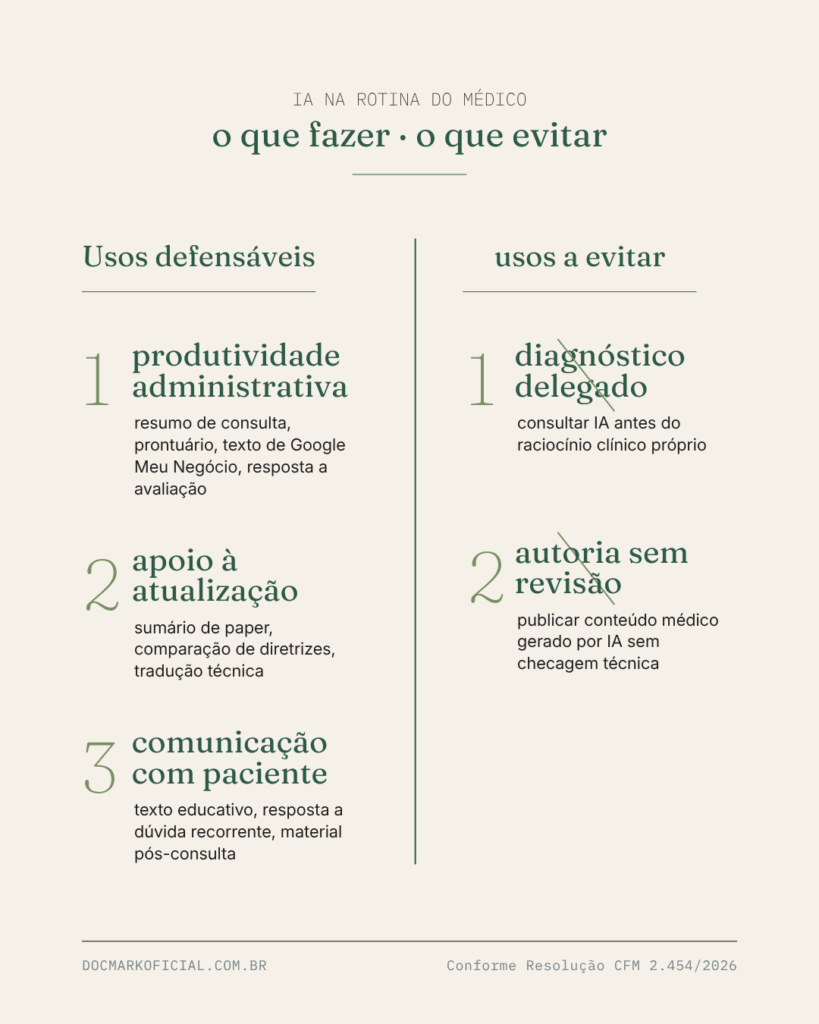

IA na rotina do médico tem três usos defensáveis: produtividade administrativa, apoio à atualização e comunicação com o paciente. E dois usos eticamente problemáticos: diagnóstico delegado e autoria clínica sem revisão. A Resolução CFM 2.454/2026 é clara: a IA é ferramenta de apoio, e o médico é o responsável final por toda decisão clínica, diagnóstica, terapêutica e prognóstica. A linha entre tempo e autoridade não muda.

O médico continua sendo a autoridade. A IA é ferramenta

A Resolução CFM 2.454/2026, publicada em 27 de fevereiro de 2026, normatiza pela primeira vez no Brasil o uso de inteligência artificial na medicina de forma específica. O artigo 4º estabelece o dever do médico de empregar a IA exclusivamente como ferramenta de apoio, mantendo-se como responsável final pelas decisões clínicas, diagnósticas, terapêuticas e prognósticas.

A formulação importa. O texto não diz que a IA é proibida, e não diz que ela é neutra. Diz que ela é apoio, e que a responsabilidade final permanece com você. Quem faz, quem assina, quem responde.

A Associação Médica Brasileira, em cartilha de orientação publicada em abril de 2026, chamou atenção para um risco específico: o viés de automação. É a tendência do profissional de atribuir confiança excessiva às recomendações da IA, reduzindo o olhar crítico sobre a decisão clínica. Esse é o erro técnico mais comum entre médicos que adotam a ferramenta sem método. Você usa uma vez, dá certo. Usa duas, dá certo. Na terceira, deixa de checar. E a quarta vai ser quando a ferramenta erra.

A IA na rotina do médico não substitui o raciocínio clínico. Ela libera tempo para que você o exerça melhor.

Os três usos defensáveis da IA na rotina do médico

A separação a seguir é prática e segue o princípio normativo do CFM. Onde a IA libera tempo sem comprometer autoria clínica, ela é defensável. Onde a IA substitui julgamento, ela é problemática.

Uso 1 · Produtividade administrativa

É o uso mais seguro e o mais subutilizado pelo médico estabelecido. Inclui resumo estruturado de consulta a partir de anotações, primeira versão de texto para Google Meu Negócio, resposta-padrão a avaliações no Google que precisam de revisão antes de publicar, organização de prontuário a partir de áudio gravado, redação de orientação pós-procedimento que será revisada antes do envio, e elaboração de modelos de prescrição (não da prescrição final, que sempre passa pela sua decisão clínica).

O tempo liberado aqui é real. Dez a quinze minutos por consulta em tarefa de redação repetitiva. Em uma semana cheia, isso significa uma manhã inteira recuperada para leitura técnica ou para casos que pediam mais atenção.

A regra única: tudo o que a IA produz é versão zero. Você é a versão final.

Uso 2 · Apoio à atualização e pesquisa

A IA é particularmente útil para sumarizar paper, comparar diretrizes entre sociedades, traduzir literatura técnica em outras línguas, e fazer busca inicial em bases de evidência. Não substitui a leitura do artigo original quando o tema é central para a sua prática. Substitui apenas a triagem inicial. Você economiza o tempo de descobrir se vale a pena ler, e ganha o tempo de ler com profundidade quando vale.

A capacidade que importa aqui não é a da IA. É a sua. Médico que sabe ler artigo crítico continua sendo o filtro entre o que a ferramenta produz e o que entra na sua prática. Médico que nunca aprendeu a ler artigo crítico é vulnerável ao viés de automação no momento exato em que mais precisaria do contrário.

Uso 3 · Comunicação com o paciente

Adaptação de linguagem técnica para texto acessível, material educativo personalizado, primeira versão de resposta para dúvidas recorrentes no WhatsApp profissional. Todos os exemplos têm o mesmo limite: você revisa antes de enviar.

A oportunidade real desse uso é melhorar a qualidade da comunicação sem aumentar o tempo dedicado a ela. Mensagem clara, orientação por escrito, conteúdo de site bem redigido. Tudo isso é parte da reputação digital que sustenta o consultório no médio prazo.

Os dois usos que o médico estabelecido nunca deve fazer

A linha aqui é a do artigo 4º da Resolução 2.454/2026. Quando a IA passa de apoio a substituta, o uso deixa de ser defensável.

Uso a evitar 1 · Diagnóstico delegado

É quando o médico digita os achados no ChatGPT e pergunta a hipótese diagnóstica antes de fazer o próprio raciocínio. Parece atalho. Não é. É inversão da ordem do conhecimento clínico.

Há dois problemas distintos aqui. O primeiro é técnico. A IA generativa é treinada em corpus textual amplo, não em prontuário do seu paciente, não em sua história clínica, e não em variáveis epidemiológicas locais. Ela pode citar hipóteses plausíveis e omitir as mais relevantes para o seu contexto. O segundo é ético-formativo. O médico que consulta IA antes do próprio raciocínio treina, ao longo do tempo, a confirmar a máquina em vez de pensar. Em uma década, isso é desqualificação silenciosa.

Você pode usar a IA depois do seu raciocínio, para checar se omitiu hipótese relevante, e mesmo aí com julgamento crítico. Mas a ordem importa.

Uso a evitar 2 · Autoria clínica sem revisão

É o uso mais comum entre médicos que entraram no Instagram nos últimos dois anos. Um agente de IA produz post, carrossel ou texto longo, e o médico publica sem checagem técnica. Funciona até a primeira informação imprecisa publicada com o seu nome. E essa hora vai chegar.

A Resolução 2.454/2026 estabelece também o dever de transparência ao paciente sempre que a IA tiver papel relevante na assistência. Por analogia, conteúdo público que carrega seu nome como fonte técnica precisa do mesmo crivo de revisão que você daria a um capítulo de livro que vai assinar. Não é exagero. É consistência ética.

O paciente já está usando IA antes de chegar ao consultório

A jornada do paciente em 2026 inclui, com frequência crescente, uma consulta prévia ao ChatGPT, ao Perplexity, ou ao overview de IA do Google. Ele chega com hipótese formada. Às vezes com sugestão de tratamento.

Isso não é problema. É a configuração nova da consulta. Seu trabalho não é confirmar o que a IA disse. É filtrar e redirecionar com o contexto clínico que só você tem.

Há três posturas comuns, e duas são erradas. A primeira é antagonizar a curiosidade do paciente, dizendo que ele não deveria ter pesquisado. Isso quebra a relação no primeiro minuto e ignora a realidade. A segunda é validar tudo o que a IA sugeriu para evitar conflito. Isso é abdicar da autoridade clínica que sustenta o seu valor profissional. A terceira é a correta: receber a hipótese do paciente, perguntar o que o levou a ela, usar isso como porta de entrada para a anamnese, e depois conduzir a consulta com o seu raciocínio próprio.

Esse padrão de consulta exige mais habilidade comunicativa, não menos. E é parte do que diferencia hoje o consultório de médico estabelecido no Rio de Janeiro do consultório que apenas reage à tecnologia sem método.

O que a Resolução CFM 2.454/2026 permite, exige e veda

A norma, publicada no Diário Oficial da União em 27 de fevereiro de 2026, organiza o uso de IA na medicina em torno de cinco eixos. Vale conhecer cada um.

Permite o uso da IA como ferramenta de apoio em assistência, gestão, pesquisa e educação. O médico tem autonomia para usar ou não a ferramenta, e tem o dever de avaliar criticamente as saídas da IA antes de tomar qualquer decisão clínica.

Exige capacitação mínima e uso crítico. Você deve manter-se atualizado quanto às capacidades, limitações, riscos e vieses conhecidos dos sistemas que utiliza. Adotar a ferramenta sem entendê-la é responsabilidade sua, não dela.

Exige uso de sistemas que atendam às normas vigentes. Isso inclui sistemas que respeitem a legislação de proteção de dados (LGPD). Inserir dado identificável de paciente em IA generativa pública, fora de ambiente seguro, é prática que a AMB explicitamente desaconselhou na cartilha de orientação de abril de 2026.

Exige transparência ao paciente sempre que a IA tiver papel relevante na assistência. Você precisa informar de forma clara e acessível, e registrar o uso em prontuário.

Veda a delegação de decisão clínica. O médico é o responsável final por decisões clínicas, diagnósticas, terapêuticas e prognósticas. A IA não substitui esse lugar em nenhuma hipótese.

A norma é equilibrada. Não proíbe a tecnologia, mas estabelece que quem assina, responde. Esse princípio é antigo na medicina. A novidade é a sua aplicação explícita à inteligência artificial.

Como a IA muda quem é encontrado online

Existe um efeito de segunda ordem do uso de IA na medicina que poucos médicos perceberam ainda. Não tem a ver com como você usa a ferramenta. Tem a ver com como a ferramenta cita você.

ChatGPT, Perplexity, Gemini e o overview de IA do Google produzem respostas com base em fontes que consideram autoritativas. Quem aparece em diretriz de sociedade médica, em paper indexado, em mídia tradicional respeitada, em blog técnico bem redigido, é citado nessas respostas. Quem está apenas em Instagram, com posts curtos e visuais bonitos mas sem presença em fontes que os modelos consideram autoritativas, fica de fora.

Para o médico estabelecido, isso muda o cálculo da presença digital. O Instagram continua sendo um canal de relacionamento e de presença simbólica no círculo médico próximo. Mas a presença citada pelo paciente quando ele pergunta para a IA depende de outras camadas. Currículo Lattes atualizado. Página própria no site da sociedade médica em que atua. Blog próprio com texto técnico assinado. Citação em jornal de circulação. Presença em material educativo respeitado.

Reputação digital em 2026 é também reputação aos olhos dos modelos de linguagem. E essa reputação se constrói com os mesmos materiais que sempre sustentaram reputação médica: produção técnica visível, citação por pares, e presença consistente em fontes confiáveis.

Como começar a usar IA na rotina sem cruzar linhas

Três passos práticos, na ordem.

Primeiro, escolha um único uso para começar, e fique nele por quatro semanas. O candidato natural é o Uso 1, produtividade administrativa. Resumo de consulta, primeira versão de texto para o site, resposta a avaliações no Google. Esses três casos te permitem desenvolver o método de revisão sem risco clínico.

Segundo, estabeleça um protocolo escrito de revisão. Antes de qualquer texto produzido com auxílio de IA ser usado externamente, ele passa por checagem técnica sua. Cinco a oito minutos por texto. Esse protocolo é o que protege a sua reputação e o que cumpre o dever de julgamento crítico previsto na Resolução 2.454/2026.

Terceiro, mantenha registro do que você está usando. Sistema, finalidade, e procedimento de validação. Esse registro tem dois usos. Internamente, te dá clareza sobre quais ferramentas trazem retorno real. Externamente, te protege caso seja questionado em algum momento sobre uso da IA na sua prática.

Em quatro a seis semanas com esse método, você terá um sentido prático claro do que a IA libera para a sua rotina e onde ela ainda é insuficiente. A partir daí, expandir para o Uso 2 (apoio à atualização) e para o Uso 3 (comunicação com o paciente) é gradual e seguro.

Conclusão

A inteligência artificial é o tipo de tecnologia que faz o médico bom ficar mais rápido e o médico ruim ficar mais perigoso. O que define em qual dos dois lados você está não é a ferramenta. É o método com que você a usa.

A Resolução CFM 2.454/2026 te dá o desenho normativo. A AMB te dá o alerta sobre viés de automação. A literatura internacional te dá a moldura ética. Mas o trabalho de aplicar tudo isso à sua rotina, com critério e sem pressa, é seu. Esse é o tipo de trabalho que reputação faz por escrito, em prontuário, e em texto público que carrega seu nome.

Você passou anos construindo o direito de ser ouvido como autoridade clínica. A IA, bem usada, libera tempo para que você continue construindo. Mal usada, apaga em silêncio o que você levou décadas para erguer.

Falar com a DocMark

Se você está pensando em estruturar o uso de IA na sua rotina sem comprometer reputação ou ética, conversamos. A DocMark trabalha exclusivamente com médicos e clínicas no Rio de Janeiro, e protocolo de uso de IA é parte do que organizamos. Uma conversa de 15 minutos, sem proposta na primeira chamada.

→ Falar com a DocMark no WhatsApp

Perguntas frequentes

O CFM permite o uso de IA na consulta médica?

Sim. A Resolução CFM 2.454/2026, publicada em fevereiro de 2026, regulamenta especificamente o uso de inteligência artificial na medicina. Ela permite o uso da IA como ferramenta de apoio em assistência, gestão, pesquisa e educação, desde que o médico mantenha o julgamento crítico sobre as saídas da ferramenta e seja o responsável final por toda decisão clínica, diagnóstica, terapêutica e prognóstica.

Posso usar ChatGPT para redigir prontuário?

Pode usar como apoio à redação, mas com três cuidados. O texto produzido pela IA é versão inicial e precisa ser revisado por você antes de ser anexado ao prontuário. Dados identificáveis do paciente não devem ser inseridos em ferramentas de IA generativa pública, conforme orientação da AMB e em alinhamento com a LGPD. O uso de IA com papel relevante na assistência exige transparência ao paciente, conforme a Resolução CFM 2.454/2026.

IA pode dar diagnóstico médico?

Não. A Resolução CFM 2.454/2026 estabelece que o médico é o responsável final por decisões diagnósticas, terapêuticas e prognósticas. A IA pode funcionar como apoio, sugerindo hipóteses ou organizando dados, mas o diagnóstico em si é ato médico privativo e não pode ser delegado.

Como saber se uma resposta do ChatGPT está correta para uso médico?

Aplicando os mesmos critérios que você aplicaria a qualquer fonte. Checar contra literatura primária quando o tema é clínico. Validar com diretrizes da sua sociedade de especialidade. E exercer julgamento crítico sobre coerência com o quadro clínico e com as boas práticas médicas, conforme previsto no artigo 4º da Resolução CFM 2.454/2026. Resposta de IA generativa não é fonte autoritativa por si. É ponto de partida para verificação.

Atualizado em 11/05/2026 · Próxima revisão prevista para 11/11/2026

Autor: Igor Castellan, fundador da DocMark.

Gostou do conteúdo?

Descubra como sua presença digital pode refletir o que você construiu.

Uma conversa de 15 minutos. Sem pitch, sem proposta na primeira conversa.

Falar com a DocMark